L’aumento del rischio informatico rende sempre più necessarie soluzioni efficaci di backup dati

La regola del 3-2-1 è una metodologia di protezione e di ripristino dei dati, nata una ventina di anni fa da un’idea del fotografo Peter Krogh, per garantire che i dati fossero protetti adeguatamente e fossero disponibili copie di backup aggiornate, da poter ripristinare in tempi rapidi, in caso di necessità. La regola del 3-2-1 è un ottimo strumento con cui le organizzazioni possono valutare l’esposizione al rischio dei dati e dotarsi di processi efficaci e sicuri di archiviazione. Nonostante questa metodologia sia stata concepita in un’era di dischi rigidi da 30 GB e backup di CD, si adatta molto bene anche alla realtà attuale, fatta di unità di archiviazione che superano diversi TB e con la tecnologia del cloud oramai onnipresente.

Con la crescita esponenziale dei dati aziendali e delle informazioni archiviate e con le minacce di malware in continuo aumento, per qualsiasi organizzazione è fondamentale dotarsi di una metodologia efficace per valutare le vulnerabilità e garantire la protezione e il ripristino dei dati.

Cosa dice la regola del 3-2-1?

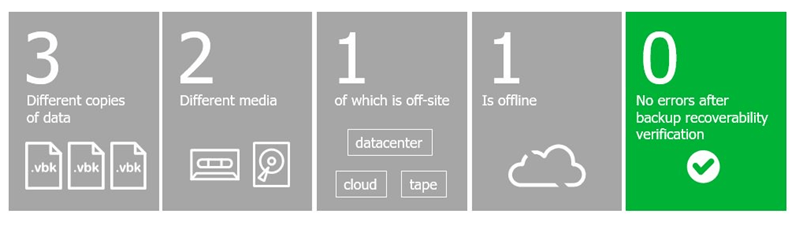

Il concetto base di questa metodologia di backup è molto semplice:

- 3 copie dei dati. Dovrebbero essere effettuate regolarmente tre copie di tutti i dati critici, con una frequenza almeno giornaliera, inclusi i dati originali e almeno due copie di backup.

- 2 tipi di archiviazione. È necessario utilizzare due diversi dispositivi di archiviazione separati, per ridurre al minimo la possibilità di errore. I dispositivi di archiviazione possono includere le unità NAS (unità disco di rete), le unità di archiviazione rimovibile (esempio cassette RDX), le copie dei dati in cloud o una libreria a nastro (anche se sempre meno utilizzata).

- 1 copia fuori sede. Almeno una copia dei dati deve essere archiviata in un luogo fuori sede per evitare che i disastri naturali o di qualsiasi altra natura come gli incendi e i furti, possano distruggere tutte le copie dei dati. Questa copia può essere consegnata fisicamente alla posizione fuori sede, come con i backup basati su supporti fisici, oppure può essere replicata tramite soluzioni in cloud.

Generalmente la soluzione in cloud è quella preferibile in quanto è automatizzata e non necessita di intervento da parte di operatori che periodicamente cambino il supporto di archiviazione e lo consegnino nel sito esterno.

Questo schema di regole di base non presume quindi alcuna tecnologia o dispositivo hardware specifici ed è adatta per affrontare quasi tutti gli scenari di disastro / errore, assicurando la resilienza dei dati di cui qualsiasi organizzazione ha bisogno al giorno d’oggi, considerando anche i continui attacchi di tipo ransomware.

Come applicare la regola del 3-2-1 in uno scenario reale?

La strategia di backup 3-2-1 è riconosciuta come best practice per la sicurezza delle informazioni e la protezione dei dati ed elimina alcuni dei rischi connessi alle procedure di backup, garantendo che non vi sia un “single point of failure (SPOF)” ossia singolo punto di vulnerabilità dei dati. Applicando la regola del 3-2-1 l’organizzazione è infatti coperta se una copia dovesse risultare danneggiata, o se una tecnologia dovesse fallire, ma anche se si verificasse un disastro naturale o una intrusione malevole nell’infrastruttura informatica, che devesse rendere inutilizzabili le copie di backup fisiche interne all’azienda.

Il processo di recupero dati, utilizzando la metodologia 3-2-1 sarebbe il seguente:

I dati originali sono corrotti, danneggiati o persi. Se la copia di produzione dei dati non è disponibile, la prima alternativa è recuperare i dati necessari dalla copia di backup archiviata internamente, su un altro supporto o sistema di archiviazione secondario.

La seconda copia dei dati non è disponibile o è inutilizzabile. Se il sistema utilizzato per archiviare la seconda copia dei dati non è disponibile o la copia dei dati è danneggiata, non aggiornata o inutilizzabile, si procede al ripristino sui server interni della copia archiviata fuori sede.

L’integrità dei dati è sempre stato un fattore fondamentale delle attività di backup dei dati: non è sufficiente eseguire semplicemente il backup: è imperativo garantire che i backup siano completi, integri e recuperabili. I test di ripristino aiutano in questo senso e sono da pianificare con cadenza periodica. Alcuni software di backup di fascia enterprise hanno inoltre dei sistemi interni per il test automatizzato della buona riuscita del backup.

Backup esterni all’azienda: la soluzione efficace e sicura del cloud backup

Scegliere servizi di backup in cloud vuol dire sostanzialmente poter sfruttare la capacità scalabile del cloud e, al tempo stesso, ridurre i costi, eliminando o riducendo l’hardware e le spese di manutenzione, quindi liberare risorse economiche e professionali affidandosi a provider in grado di assicurare servizi economici, affidabili e sicuri.

Nella scelta della soluzione di cloud backup vanno considerati alcuni fattori importanti.

Il regolamento generale sulla protezione dei dati (GDPR) è un aspetto che potrebbe influire sul processo di protezione e ripristino dei dati. Il GDPR, infatti definisce le misure che le organizzazioni devono adottare per proteggere i dati personali dei propri utenti. Ciò significa che è necessario garantire che ovunque siano archiviate le tre copie di dati, le misure di sicurezza adottate, sia fisiche sia digitali, devono essere adeguate e proteggere dalla violazione dei dati.

In ambito GDPR c’è poi il tema, ancor più complesso, di dove i dati archiviati su cloud risiedano realmente. L’accesso sproporzionato dei servizi di sicurezza statunitensi ai dati di massa europei, è stato uno dei motivi cruciali per cui il trasferimento di dati personali attraverso l’Atlantico è stato ritenuto illegale dalla Corte di giustizia dell’UE, e dunque non conforme con le normative del GDPR.

L’altro aspetto da tenere in considerazione nel caso di backup in cloud è la distanza del datacenter e il costo di recupero dei dati. Nel caso di dover recuperare i dati bisogna infatti considerare i tempi per il download dal cloud e dei costi “nascosti” che gran parte dei cloud provider applicano sul traffico dati in uscita. Per questi motivi è bene valutare il posizionamento dei dati su di un datacenter locale che consente, in caso di necessità, di recuperare anche fisicamente i dati e di avere dei costi certi.

Un ultimo aspetto da considerare è l’aumento dei casi ransomware che rende opportuno valutare una soluzione che consenta l’immutabilità dei dati per un certo numero di giorni. Questo consente di avere la certezza che i dati non vengano in alcun modo crittografati in seguito ad attacchi ransomware

L’utilizzo di un servizio di archiviazione su cloud, per archiviare la copia fuori sede, rende necessario l’approfondimento sui dettagli relativi ai processi di protezione del dato: garantisce l’integrità e la recuperabilità dei dati? Garantisce l’applicazione della normativa del GDPR? Dove sono ubicati fisicamente i server? E’ possibile applicare regole di immutabilità dei dati?

Sono queste le motivazioni che ci hanno indotto a realizzare una soluzione di backup cloud sul datacenter della nostra sede: garantire ai nostri clienti un’efficace procedura di backup e ripristino, esterno alla sede del cliente e basato sulla tecnologia sicura e affidabile di Veeam, leader mondiale delle soluzioni di backup e ripristino